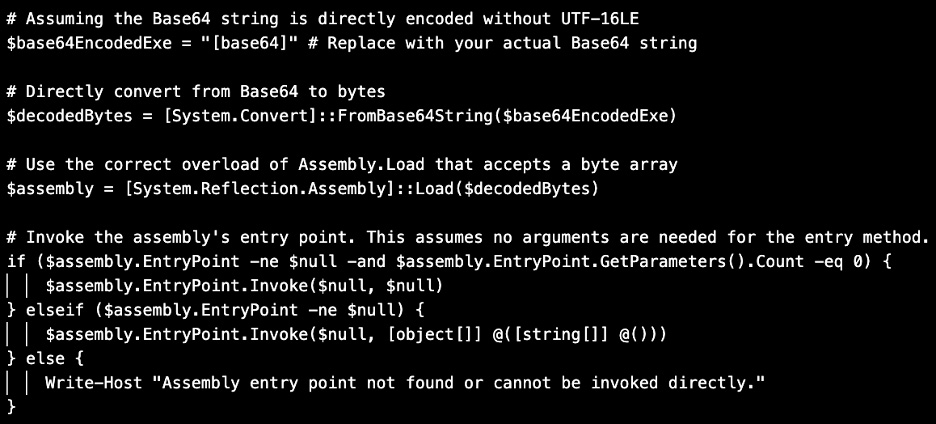

Un attore di minaccia noto come TA547 ha condotto una serie di attacchi a diverse aziende in Germania utilizzando uno script PowerShell che è presumibilmente stato creato con l’aiuto di un sistema di intelligenza artificiale generativa come ChatGPT, Gemini o CoPilot.L’aggressore ha orchesstrato una campagna di phishing, rilevata durante il mese di marzo, che ha preso di mira decine di organizzazioni tedesche allo scopo di diffondere il malware Rhadamanthys, un cosiddetto “information stealer”.E’ stata la società di sicurezza informatica Proofpoint ad aver attribuito attribuito l’attacco a TA547, un broker di accesso iniziale (IAB) attivo dal 2017 e noto per fornire una varietà di malware per sistemi Windows e Android. TA547 è anche noto con il nome di Scully Spider.Un elemento interessante evidenziato dai ricercatori di Proofpoint è il fatto che lo script PowerShell utilizzato per distribuire Rhadamanthys presentava caratteristiche tipiche del codice generato da soluzioni di intelligenza artificiale generativa, come ad esempio commenti meticolosi e ben formattati, elementi spesso assenti nel codice creato dagli sviluppatori umani. Chiaramente ciò non è sufficiente ad essere considerabile come prova dell’uso dell’IA, ma i ricercatori ritengono che vi sia una forte probabilità che lo script sia stato utilizzato usando un LLM. Non è certo una sorpresa il fatto che l’Intelligenza Artificiale sia uno strumento sfruttato anche dagli attori di minaccia per ottimizzare le loro attività. In precedenza avevamo già sottolineato come le IA generative sono in grado di realizzare email di phishing molto più credibili ed efficaci, ma anche della possibilità di impiegare l’IA per eseguire analisi di ricerca di vulnerabilità.L’uso di questi strumenti per scrivere codice è solamente il passo successivo, con implicazioni di ampia portata: l’IA può consentire la creazione di malware molto più sofisticato con capacità di offuscamento, automazione e personalizzazione elevate dando modo anche ad hacker e criminali meno esperti di realizzare il proprio arsenale d’attacco.Uno scenario che imporrà un cambiamento d’approccio anche per i ricercatori di sicurezza che saranno costretti ad evolvere le loro tecniche di analisi e rilevamento – magari sfruttando anch’essi le potenzialità dell’IA – per rispondere efficacemente all’evoluzione delle minacce informatiche.L’impiego degli strumenti dell’intelligenza artificiale da parte degli attori di minacce sottolinea inoltre l’importanza di una regolamentazione e di un controllo più stringenti su queste tecnologie, al fine di impedirne l’uso improprio e limitare i danni per la società.